エッジAI導入のリアル事例と活用シーン|無料相談で御社の可能性を診断

最新のエッジAI導入事例を徹底解説!製造・小売・医療・農業・インフラなど多業種での活用シーンを紹介。無料相談で御社の業務課題に最適なエッジAI導入法を見つけましょう。

当社でのエッジAI開発・実装の実務経験をもとに、本記事を含む2部構成で、エッジAI技術のトレンドと実装時に考慮すべきポイントをお伝えいたします。

・(1)エッジAI技術のトレンド(本記事)

・(2)エッジAIの実装時に考慮すべき5つのポイント

エッジAIとは?

エッジAIとは、データの収集・処理・判断をクラウドではなく端末(エッジ)側で実行する先進的なAI技術です。

カメラやセンサー、スマートフォンやタブレットなどのIoTデバイスにAIを搭載し、その場でリアルタイム処理を行うことで、低遅延・高セキュリティ・通信コストの削減といったメリットがあります。

近年では、監視カメラ映像のリアルタイム解析による異常検知など、エッジAIの実用化が急速に進展しています。

当社でも、エッジAIに関するコンサルティングや実装支援のご相談を数多くいただいております。

本記事では、エッジAIの実装において利用される技術やハードウェアをご紹介し、その中でハードウェアのトレンドや性能について解説します。また、活用事例についても紹介します。

エッジAIとクラウドAIの違い

エッジAIとクラウドAIの違いとして大きいものは「処理する場所の違い」があげられます。

| エッジAI | クラウドAI | |

| 処理場所 | デバイス側(ローカル) | データセンター |

| 通信依存 | ほぼ不要 | 常にネット接続が必要 |

| 応答速度 | 非常に速い(リアルタイム) | 遅延がある場合がある |

| セキュリティ | 高(データが外に出ない) | 中〜低(通信リスクがある) |

| メリット | ・処理がすぐ終わる(リアルタイム)

・通信しないのでセキュリティも安心 ・インターネットを使わないから通信コストも安い |

・高性能なコンピュータで複雑な処理も得意

・たくさんのデータをまとめて分析できる |

| デメリット | ・機械が小さいため複雑な処理には限界がある | ・データを送るので時間がかかることがある

・インターネットが必要、情報漏洩のリスクも |

「その場で素早く処理」したい場合はエッジAI、「たくさんのデータをしっかり分析」したい場合はクラウドAIが得意です。

5GやIoTとの連携が現場で注目される理由

エッジAIは、5G回線の“すぐに届く”スピードと、モノ同士がつながるIoTのしくみととても相性がよく、実際の仕事現場でスムーズな判断が必要な場面で使われることが増えています。

たとえば、道路や建物の監視カメラ、製造工場の設備、店舗の在庫管理などで、すぐに反応してくれるAIの仕組みとして注目されています。

処理速度の速さはどう活用される?

たとえば、ある工場では製品にキズがあるかどうかを0.1秒以内に見分けて取り除くしくみにエッジAIが使われています。

また、お店ではお客様の動きをすぐに読み取って、その場で広告やおすすめを表示する活用方法もあります。

こうしたスピードが求められる場面では、クラウドAIでは間に合わないため、その場で判断できるエッジAIが選ばれている事例が多くなっているのです。

実際にどう使われる?エッジAIの導入事例6選

エッジAIの監視カメラ映像のリアルタイム解析は、産業分野のさまざまな現場で活用されています。

ここでは、実際にどのような場面で導入されたのかを6つご紹介します。

活用事例1:監視カメラ映像で人の動きを見える化

Raspberry PiとCoralを活用して、監視カメラの映像から人の動きをリアルタイムに追跡し、平面上にマッピングするエッジAIシステムが開発されています。

この仕組みでは、高画質なFull HD映像をEdge TPU(専用AIチップ)で処理し、1秒に約2コマのスピードで人の動きを判断できます。

この速度は、人が歩くスピードには十分対応できる性能で、店舗の入退店数や混雑状況の可視化、通行量のカウント、属性分析、行動検知などの現場で幅広く使える事例です。

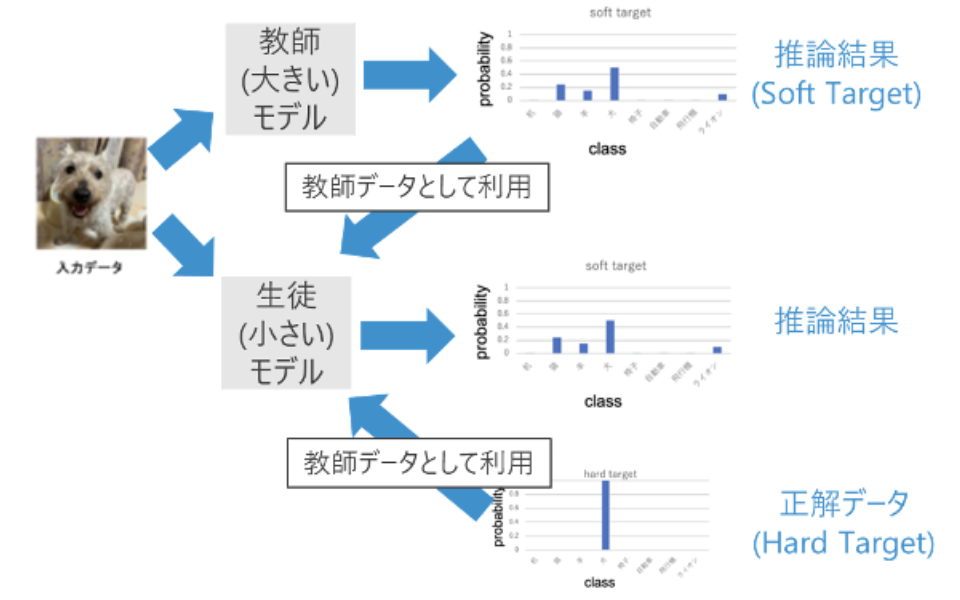

活用事例2:蒸留技術で異常検知モデルを小型化・高精度化

エッジAIを使って製品の外観検査(異常検知)を行うシステムに対し、「蒸留」という技術を用いて軽量化と精度向上を同時に実現しました。

今回は、画像から正常・異常を分類するモデルに蒸留を適用し、誤検出率を約40%低減することが可能になりました。

これにより、限られた端末数でも多くのモデルを動かせるようになり、現場の処理速度向上とコスト削減を同時に達成した成功事例です。

今後のエッジAI普及に向け、軽量モデルの需要はさらに高まっており、蒸留は有効なアプローチといえます。

活用事例3:量子化+TensorRTで商品検出AIを2倍高速化

小売業向けアプリで商品を画像から検出するAIにおいて、処理速度の課題を解決するため、モデルを「量子化(Int8/FP16)」し、さらにNVIDIAのTensorRTライブラリを使って最適化を実施。

これにより、モデルの精度を保ったまま、推論スピードが最大約2倍に向上しました。

この取り組みは、店舗でのリアルタイム商品棚監視や在庫チェックなど、即応性が必要なエッジAI事例として非常に有効です。

※量子化:AI内部の計算を軽くする技術で、処理時間を短縮しつつエッジ端末での動作を可能にします。

※TensorRT:ネットワークを高速化する仕組みで、精度はそのまま、レイテンシーを大きく削減できるのが特長です。

活用事例6:コマツの「移動式クレーンの安全監視」システム

建機大手のコマツでは、NVIDIA社のJetson TX2というAI用GPUを使い、2.9トンクラスの移動式クレーンの周囲に設置したカメラ映像をエッジAIでリアルタイム処理するシステムを開発しています。

これにより、クレーンの周囲にいる作業員や人の動きを即座に検知し、警告を発することで事故リスクを下げることができます。

この仕組みは、現場作業の安全性を高めるエッジAIの有効な導入事例として注目されています。

※出典:Coral「https://car.watch.impress.co.jp/docs/news/1143321.html」

【業種別】エッジAIの活用シーンガイド

ここからは、業種別にエッジAIの導入がおすすめなシーンについてご紹介します。

製造業:不良品検出と自動化ラインの最適化

①画像認識による外観検査

自動化ラインの最適化

製造ラインにカメラとエッジAIを組み込み、製品の外観を自動で検査するシステムが活用されています。

これまで人が目で確認していた作業をAIがリアルタイムで不良品を判定することで、検査のスピードと精度が向上します。

生産性が40%アップした実績もあります。

②異常振動のリアルタイム検知

機械に取り付けたセンサーで振動のパターンをエッジAIが常に分析し、異常を感じ取ると即時にアラートやライン停止を行う仕組みが使われています。

これにより、大きな故障や長時間の停止を未然に防ぎ、保守コストを削減。

製造現場での安全性・安定稼働を支える代表的なエッジAI事例です。

小売業:在庫管理・客動線解析の効率化

冷蔵庫内センサーでの在庫管理

①店舗内AIカメラでの購買行動分析

店内に設置したAIカメラでお客様の行動をリアルタイムに解析し、人気商品の配置や導線を改善した事例です。

来店客がどこに立ち止まり、何を手に取るかを可視化でき、プロモーション施策の精度も向上。

結果、売上アップにつながった店舗もある注目のエッジAI事例です。

②冷蔵庫内センサーでの在庫管理

冷蔵庫にエッジAIを搭載したセンサーを設置し、商品の在庫状況を常時モニタリング。

在庫が減ったタイミングを自動で検知し、必要な商品だけをリアルタイムで補充できます。

その結果、欠品ゼロの店舗運営が可能となり、販売ロスや手作業による確認の手間も大幅削減可能になります。

農業:スマート農業での環境最適化

安心・安全な農業の実現

①農地センサーとAI連携での潅水制御

畑に設置した土壌センサーが水分量を測定し、エッジAIが天気予報と連携して最適な水やりのタイミングを判断します。

この仕組みにより、ムダな潅水を減らし水の使用量を大幅にカットできるようになります。

省エネ・省人化に役立つ、農業分野で注目を集めるエッジAI事例です。

②病害虫の画像認識による早期発見

ドローンやカメラで葉の様子を常時撮影し、AIが病気や虫の兆候を画像から見つけ出すエッジAIシステムが活用されています。

早期発見により、農薬を最小限に抑えて作物を守る取り組みが進んでおり、安心・安全な農業の実現にも貢献する事例です。

インフラ:老朽設備の監視と保守

インフラの監視と保守

①ブリッジインスペクションAI

橋梁の点検において、ドローンで撮影した画像をその場でエッジAIが解析し、ひび割れなどの異常を検出するシステムが活用されています。

これにより、高所作業の省人化と作業員の安全確保が両立できる事例として、インフラ点検の効率化に大きく貢献しています。

②電柱・トンネルの劣化監視

電柱やトンネルに取り付けたセンサーが、振動や傾きの変化をリアルタイムで検出し、エッジAIが異常を即座に分析する監視システムです。

この仕組みにより、設備の劣化や構造不良を早期に把握でき、重大事故の予防や点検業務の負担軽減にもつながる注目のエッジAI事例です。

よくある質問

Q1:エッジAIはどの業界・業種でも導入できますか?

A:はい、製造業・小売業・医療・農業・インフラ・物流・建設など、多様な業界で導入事例があります。

アラヤでは、お客様の業種や課題に合わせた導入プランをご提案しています。

Q2:エッジAIの導入にどのくらいの費用がかかりますか?

A:規模や要件により異なりますが、PoC(実証実験)段階で数百万円から対応可能です。

無料相談にて概算費用や導入方法をご案内いたします。

Q3:社内にAIの専門知識がなくても導入できますか?

A:はい、ご安心ください。アラヤでは要件定義から開発、運用まで一貫してサポートいたします。

実際に、AI未経験の企業様からも多くのご相談と成功事例をいただいています。

Q4:実際に導入して成果が出ている事例はありますか?

A:はい、多くの企業様にご利用いただいており、外観検査、点検自動化、需要予測などで大幅な効率化とコスト削減が実現しています。

実際には「蒸留」という手法を用いて、外観検査において誤検出率を約40%低下させることができました。

Q5:まずは小規模で試すことはできますか?

A:もちろんです。アラヤではスモールスタート型のPoC(試験導入)プランをご用意しております。

まずは無料診断にて、御社に適した開始方法や課題をご提案いたします。

詳しくはこちらから相談ください。

■続きはこちら

・(1)エッジAI技術のトレンド(本記事)

・(2)エッジAIの実装時に考慮すべき5つのポイント

株式会社アラヤ

先端AIとニューロテックを基盤とするディープテックベンチャーです。ムーンショット型研究開発への参画をはじめ、企業・大学との共同研究実績を多数有し、現役研究者とエンジニアが一体となった研究支援を提供しています。大学・研究機関における持続可能な研究体制の構築と研究力強化に貢献してまいります。

主な事業概要

AIアルゴリズム開発(ディープラーニング・エッジAI・自律AI)、建設DXソリューション、研究現場の業務効率化支援(Research DX)など、基礎研究から社会実装まで一貫して手がけています。

受託開発・お問い合わせ

受託開発・お問い合わせ